Generative KI ist in aller Munde und dabei, sich auch in der Popkultur auszubreiten. Aber brauchen wir wirklich auch noch KI-generierte Musik oder Filme?

Generative KI basiert auf sogenannten Large Language Models (LLMs), großen Sprachmodellen, die auf neuronalen Netzen und Wahrscheinlichkeitsmodellen beruhen. Sie generieren Texte, Bilder oder Audio-Inhalte, indem sie statistische Muster aus extrem großen Datenmengen erkennen und Vorhersagen über die wahrscheinlichsten Wörter, Sätze, Pixel oder Töne treffen.

Anders als traditionelle Software, folgt ein LLM keinem festen Regelwerk, sondern erzeugt Inhalte flexibel und kontextabhängig. Es kann dadurch eigenständig Werke zu erstellen, die allerdings nur auf Trainingsdaten beruhen, also auf Texten, Musik oder Bildern, die von Menschen aus Fleisch und Blut erstellt wurden.

Die Sprachmodelle nehmen also bereits vorhandendes Datenmaterial, dessen Herkunft wir nicht kennen, und setzen es neu zusammen. Und wird zum Problem. Nicht nur in der Musik, sondern überall.

Über die lange Liste der Risiken und Nebenwirkungen von KI wird bisher kaum diskutiert. Stattdessen wird jedes neue KI-Produkt in Medien derzeit völlig unkritisch als Revolution präsentiert. So wie der zielgruppen-optimierte, KI-generierte Möchtegern-Popstar „Ben Gaya“ oder der Roboter AI-da, dessen Gemälde bei Sotheby’s gerade für 1,2 Millionen Euro versteigert wurde. Nicht etwa, weil es so gut wäre, sondern nur weil es von KI gemalt wurde.

Doch die Gefahren, die uns durch das unbegrenzte Wachstum von KI in alle Bereiche unseres Lebens drohen, sind groß.

Hier der Beipackzettel, den uns die Anbieter von KI-Modellen bisher vorenthalten.

Anwendungsgebiete von KI

Generative KI findet zunehmend Anwendung in Bereichen wie Kundenservice, Journalismus, Marketing und in allen kreativen Prozessen. Entwickler verlassen inzwischen beim Coden auf KI und auch in der Musik oder Kunstwelt, arbeitet man wie selbstverständlich mit Künstlicher Intelligenz. Aber auch ganz normale Büroarbeiten erledigt heute vielfach schon ChatGPT.

Die Fähigkeit, Inhalte schnell, effizient und kostengünstig zu erstellen, wird von den Anbietern, allesamt superreiche US-Konzerne, als Lösung für den Fachkräftemangel beworben. Zudem kann sie repetitive Aufgaben übernehmen und Menschen bei alltäglichen Aufgaben unterstützen. LLMs sind vor allem dafür geeignet, Texte auszuformulieren und zu korrigieren. Wir werden künftig selbstverständlich darauf zugreifen, wie auf eine Rechtschreibprüfung. Es gibt also ein paar wirklich sinnvolle Anwendungen für KI.

Risiken und Nebenwirkungen

Generative KI kann allerdings auch weitreichende Nebenwirkungen und Risiken haben:

- Fehlende Wahrheitsüberprüfung

Die KI generiert oft inhaltlich überzeugende, aber falsche oder ungenaue Informationen. Sie erfindet Informationen und hat keinen Anspruch auf Korrektheit. Wenn man sich also auf KI verlässt, ist man wahrscheinlich verlassen, denn für die Arbeit einer KI fühlt sich niemand verantwortlich. - Selbstverstärkender Datenkreislauf

KI-Modelle nutzen das im Web allgemein zugängliche Wissen, egal wie gut oder schlecht das auch sein mag. Eine Qualitätsprüfung findet dabei nicht statt, schließlich kann KI nicht bewerten, was gut und was falsch ist. Und KI-generierte Inhalte werden massenhaft im Web veröffentlicht, sodass ChatGPT seine Informationen irgendwann überwiegend aus KI-generierten „Fakten“ beziehen wird. Neue, von Menschen erstellte Informationen über wichtige Themen, werden also zunehmend Mangelware. - KI ist nicht kreativ

Durch die Automatisierung vieler kreativer und redaktioneller Tätigkeiten werden bald unzählige Arbeitsplätze gefährdet sein. Die Musikindustrie wird versuchen, Musik auf Knopfdruck für die Algorithmen von TikTok, Youtube und Spotify zu produzieren und sie dafür mit den populärsten Songs füttern. Dazu erstellt Midjourney noch eine süße Animation, fertig ist der konfektionierte Popstar für die Generation TikTok. Dadurch entsteht immer mehr von demselben kommerziellen Einerlei und die Originalität schwindet. Bisher konnte KI noch kein einziges relevantes Stück Musik hervorbringen. Und da LLM weder Freude noch Schmerzen kennt und auch keinen Geschmack hat, bleibt das wohl auch so. - Verlust individueller Fähigkeiten

Der zunehmende Einsatz von KI kann zu einer Entwöhnung bei Routineaufgaben führen. Entwickler verlernen das programmieren, Musiker lernen erst gar nicht, ein Instrument zu spielen oder Musik selbst zu produzieren, sondern alte Versatzstücke werden immer neu zusammengesetzt. Dadurch könnte die Eigeninitiative und Weiterentwicklung persönlicher Fähigkeiten abnehmen und die Kreativität verschwinden. - Unzureichende ethische und rechtliche Rahmenbedingungen

Bisher ist außerdem überhaupt nicht geklärt, wer für fehlerhafte oder irreführende KI-Informationen haftet, insbesondere in sensiblen Bereichen wie Medizin oder Recht. Die KI-Unternehmen blenden diese Risiken bisher aus und behaupten stattdessen seit Jahren, das werde alles verschwinden, wenn die Modelle nur besser werden.

Doch was, wenn sie gar nicht besser werden? Was wenn der Fehler darin liegt, dass eine künstliche Intelligenz einfach unmenschlich ist? Was, wenn das alles nur ein riesiger, stinkender Haufen Scheiße ist?

Wissenschaftler der Universität Glasgow haben in einem viel beachteten Paper dargelegt, dass ChatGPT tatsächlich einfach nur „Bullshit“ produziert, weil die KI gleichgültig gegenüber der Wahrheit sei.

Wechselwirkungen mit der Gesellschaft

Die neue Technologie hat das Potenzial, gesellschaftliche Strukturen zu sprengen und bestehende Ungleichheiten zu verschärfen. Die Nutzung generativer KI kann das Vertrauen in traditionelle Informationsquellen und Institutionen untergraben, besonders wenn ihre Entscheidungen auf rein statistischen Modellen ohne Gewissen basieren. Einige wenige superreiche Software-Giganten bauen ihr Geschäftsmodelle auf unserem Wissen, unseren Erfahrungen und unserer Arbeit, ohne uns dafür zu bezahlen. Wenn aber niemand mehr das Internet nutzt, sondern nur noch eine KI befragt, gibt es auch kein durch Menschen aktualisiertes Wissen mehr. Dann bleibt die KI quasi in der Zeit gefangen. Ein Fortschritt ist das nicht, sondern ein Rückschritt.

Einen massiveren Urheberrechtsbruch, gab es vermutlich seit dem Aufkommen der P2P-Tauschbörsen nicht mehr.

Um Wettbewerber brauchen die Vorreiter auch nicht fürchten: man braucht so extrem viele Ressourcen und so unfassbar viel Geld, dass es quasi unmöglich ist, an diesem Markt demokratisch teilzunehmen. Das ist nur noch mit der Raumfahrt vergleichbar. Die gesamte EU hat noch keinen relevanten Wettbewerber hervorgebracht, der es mit den US-Giganten aufnehmen könnte. Über die gigantischen Menge an Energie, die für die fragwürdige Technologie verbraucht wird, brauchen wir gar nicht erst zu reden. Scheinbar wird der Klimawandel inzwischen sowieso als unveränderlich in Kauf genommen und damit die Haltung: nach uns die Sintflut.

Besondere Vorsichtsmaßnahmen und Warnhinweise

- Manipulationspotenzial

Generative KI kann auch dafür genutzt werden, politisch oder wirtschaftlich motivierte Inhalte zu verbreiten. In Ländern mit staatlicher Zensur besteht das Risiko, dass KI als Propaganda-Instrument zum Brainwashing eingesetzt wird. „Big Brother“ ist in China längst Realität geworden und die USA sind auf dem direkten Weg dort hin. Elon Musk hat gerade vorgemacht, wie man die Welt über das eigene Social Network mit Fake-News flutet, nur um seinem bevorzugten Kandidaten ins Amt zu verhelfen. Und ist inzwischen so unfassbar reich, dass er sich alles einfach kaufen kann, um seine Agenda zu pushen. - Einfluss auf die Kreativwirtschaft

Kreative Berufsfelder sehen sich durch die massenhafte Verwendung und Generierung KI-basierter Inhalte bedroht. Viele Künstler und Urheberrechteinhaber protestieren inzwischen gegen die Verwendung ihrer Werke oder Stimmen für KI-Trainingsdaten. Scarlett Johanson musste OpenAI erst abmahnen lassen, damit ihre Stimme nicht einfach ungefragt als Stimme von ChatGPT verwendet wurde. Im Gegensatz zu vielen anderen, sind Musiker daran gewöhnt, sich gegen Raubkopierer wehren zu müssen. Andere kreative Branchen sollten sich das zum Vorbild nehmen und das nicht einfach geschehen lassen. Auch Web-Inhalte sind urheberrechtlich geschützt und dürfen nicht einfach nach Belieben verwurstet werden. Und doch geschieht das gerade jeden Tag. - KI wird deinen Job übernehmen

Es gibt bereits jetzt große Anstrengungen, Arbeitsplätze mit Hilfe von KI abzubauen. Schließlich sind Menschen teuer und wenn KI dieselbe Arbeit viel günstiger macht (wenn auch nur halb so gut), wird kein großes Unternehmen sich dieser Technologie verschließen. Die KI-Anbieter werden nicht müde zu warnen, wer sich KI verweigere, werde künftig keinen Job mehr haben. Und zwingen damit Menschen in ihr System. Die gesellschaftlichen Folgen dieser rasanten Entwicklung sind momentan noch gar nicht abzusehen. Es ist an der Zeit, sich über die Folgen klar zu werden und die häufig manipulativen Aussagen der KI-Konzerne kritisch zu überprüfen.

Anwendungseinschränkungen und Regulierung

Ab 2025 tritt der AI Act der EU in Kraft, der die Transparenz und Sicherheit von generativer KI in Europa regeln soll. Dies soll sicherstellen, dass Nutzer erkennen können, wann sie mit KI interagieren und auf Basis welcher Daten die Technologie trainiert wurde. Die Regulierungen zielen darauf ab, potenzielle Risiken, Verzerrungen und Diskriminierung zu minimieren. Dazu werden Experten aus allen möglichen Fachgebieten befragt.

Auch wenn bereits jetzt viele laut jammern, dass die EU zu vieles reguliert, ist es dringend notwendig, den KI-Giganten auf die Finger zu schauen. Denn aktuell verleiben sie sich das gesamte Schwarm-Wissen im Netz einfach ein, um es dann in ihren kostenpflichtgen Tools quasi als „Remix“ zu verkaufen. Ohne irgendwelche Rechte an den verarbeiteten Daten zu besitzen oder die Urheber zu vergüten.

Wissenschaftler der Universität Washington sprechen im Zusammenhang mit generativer KI sogar ganz unverblümt von einem Angriff auf die Wissensgesellschaft:

“Die Fähigkeit, unbegrenzt plausibel aussehenden Müll praktisch kostenlos zu produzieren, ist ein DDoS-Angriff auf schriftlich festgehaltenes Wissen.” Quelle

Dosierungsanleitung: Wie KI angewendet werden sollte

Generative KI kann zwar einige nützliche Werkzeuge bieten, birgt jedoch erhebliche Risiken und gesellschaftliche Herausforderungen, die den tatsächlichen Nutzen bei Weitem überwiegen. Wenn sie dazu missbraucht wird, ein Geschäftsmodell auf Basis des kreativen Schaffens von Milliarden Menschen auf der ganzen Welt aufzubauen, ohne sie zu beteiligen oder auch nur zu fragen, haben wir ein grundsätzliches Problem.

Zudem lösen die Modelle Probleme, die wir eigentlich gar nicht hatten. Es gibt weder einen Mangel an guten Texten, noch an Musik, Kunst oder Bildern. Ganz im Gegenteil. Und es gibt auch keinen Mangel an guten Suchmaschinen, die alle unsere Fragen beantworten, uns aber auch die Quellen zeigen, damit wir die Wahl haben, wem wir als Quelle vertrauen möchten. Die einzige sinnvolle Anwendung von generativer KI ist derzeit, Menschen beim Schreiben oder Korrigieren von Text zu helfen oder beim Coden. Und das ist zwar nice to have, rechtfertigt aber keine solchen Auswüchse in alle Bereiche unseres Lebens.

„Es mag bestimmte Anwendungsfälle geben, in denen generative KI nützlich sein kann (zum Beispiel beim automatischen Vervollständigen von Programmiercode bei bereits bekannten Problemtypen), aber das bedeutet nicht, dass es in anderen Anwendungsfällen rational Sinn ergibt. Genau das verstehen viele falsch. Der derzeitige Unsinn in der KI besteht darin, generative KI (oder einfach nur KI) für alles Mögliche nutzen zu wollen.“ (Prof. Dr. Dagmar Monett, Informatikprofessorin via Linkedin)

KI sollte von uns allen viel kritischer betrachtet und genutzt werden, als bisher. Sie macht uns faul und dumm und sie gibt uns das Gefühl produktiver zu sein, während wir damit doch eigentlich nur einen immer größer werdenden Haufen mäßig interessanter Dinge damit produzieren und uns abhängig von ein paar wenigen Anbietern machen.

KI ist eine Blackbox, wir wissen nicht, mit welchen Daten sie gefüttert wird und können den Ergebnissen nicht vertrauen. Die globalen Folgen des unkontrollierten Wachstums dieser hochriskanten Technologie in alle Bereiche unseres Lebens sind überhaupt noch nicht absehbar. Wäre KI ein Arzneimittel, müsste man es aufgrund der großen Risiken verbieten.

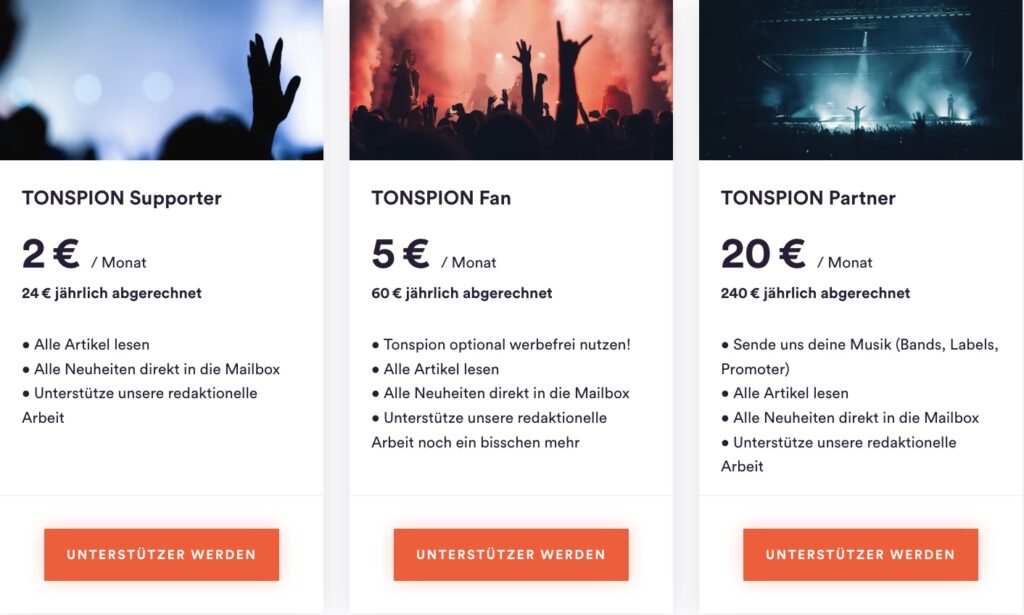

Tonspion Backstage Pass

In eigener Sache: Wir möchten unsere Social Media Profile löschen und unabhängig von nerviger Bannerwerbung werden. Und dazu brauchen wir dich: Unterstütze unsere Arbeit und hol dir den Tonspion Backstage Pass ab 2 Euro/Monat.

Sobald wir genügend Mitglieder haben, können wir wieder unabhängig von den großen Plattformen arbeiten.